Por que o áudio “assustador” do campo magnético da Terra está intrigando a web? – Times de Todos

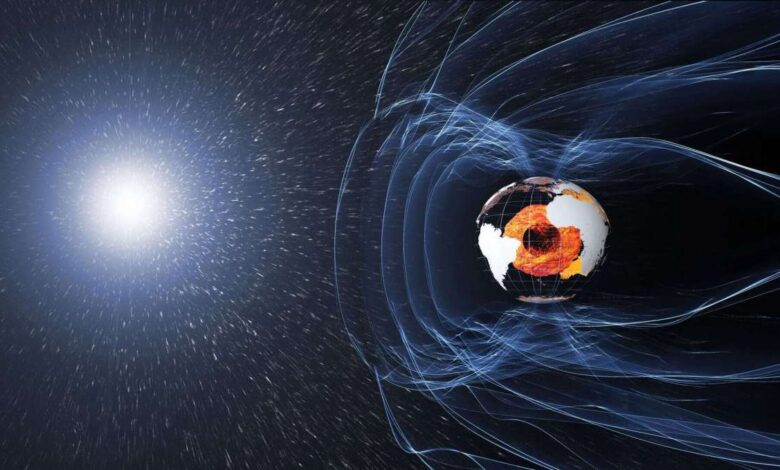

Uma gravação intrigante voltou a ganhar destaque nas redes sociais ao transformar dados científicos em uma experiência sonora sombria. O áudio, criado pela Agência Espacial Europeia (ESA) a partir de informações da missão Swarm, utiliza a técnica de sonificação para representar o campo magnético do nosso planeta. O resultado não é nada relaxante: soa como o estalar de madeira e o impacto de rochas em um ambiente tenso.

O som, na verdade, é uma reconstrução do Evento de Laschamps, uma inversão de polos ocorrida há 41 mil anos, quando a proteção da Terra caiu para apenas 5% de sua força total. O interesse renovado no tema coincide com discussões sobre a Anomalia do Atlântico Sul, que atinge parte do Brasil e da América do Sul, onde o campo magnético é mais frágil e exige cuidados especiais com satélites.